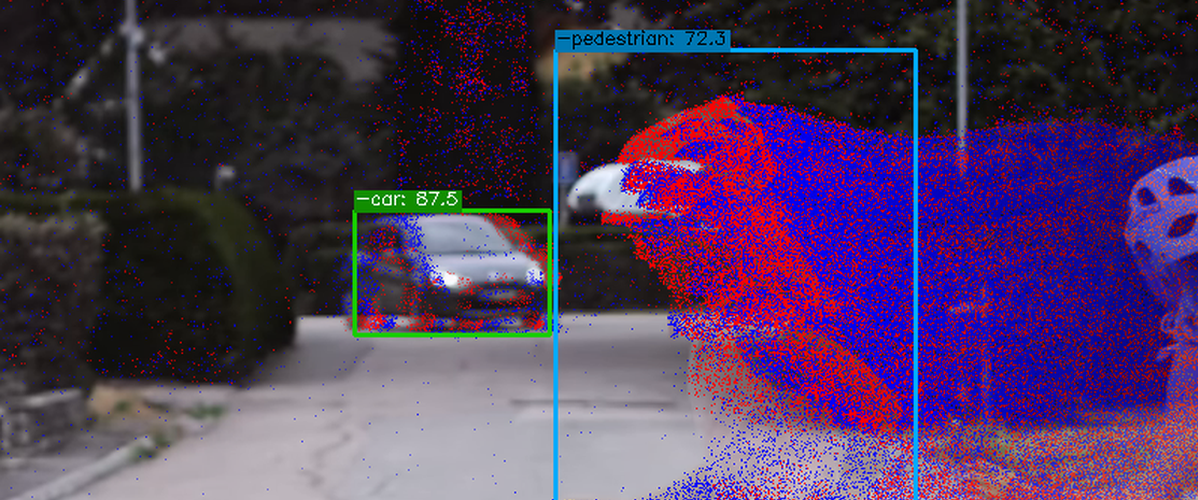

• Une équipe de chercheurs de l’Université de Zurich travaille sur l’utilisation de ce type de dispositif pour l’aide à la conduite, afin de permettre aux véhicules de détecter les obstacles plus vite.

• Ces caméras n’observent que les pixels qui changent en continu, réduisent le flou et optimisent le stockage de données. En Chine, une équipe de recherche a développé un capteur qui capte jusqu’à 10000 images par seconde.

Et si une caméra pouvait consommer jusqu’à 100 fois moins d’énergie et être 100 fois plus rapide qu’une caméra traditionnelle dans la transmission d’informations ? C’est la promesse des caméras bio-inspirées, ou caméras neuromorphiques. En Anglais, ces « event cameras » se concentrent uniquement sur les pixels qui bougent entre deux instants, et observent le monde quasiment en continu au lieu de capturer un certain nombre d’images par seconde. Cela permet à la fois d’éviter d’enregistrer des données inutiles, c’est-à-dire les pixels qui restent statiques, et de réduire drastiquement les flous. « Les données sont appelées « events », puisqu’une fraction du signal est mesurée grâce à des puces électroniques spécifiques », explique Daniel Gehrig, chercheur au GRASP Lab de l’Université de Pennsylvanie.

L’enjeu de l’équipe de recherche est de coupler une caméra neuromorphique à un algorithme de prise de décision sans perdre en efficacité.

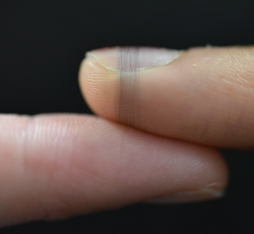

« Ces caméras, comme celles proposées par la société française Prophesee, exposent les pixels continuellement et ne mesurent que quand la lumière change, ce qui permet de suivre les signaux en continu. » En d’autres termes, il ne peut pas y avoir de mouvement qui puisse échapper au capteur. « La vitesse de la caméra est équivalente à 5000 images par seconde : il lui faut donc 0,2 milliseconde pour observer un changement, ce qui la rend 100 fois plus rapide qu’une caméra traditionnelle. »

Diminuer le temps de réaction des systèmes d’aide à la conduite

Quand il était au département d’informatique de l’Université de Zurich il y a encore quelques semaines, Daniel Gehrig a publié un article dans la revue Nature qui propose l’utilisation de ce type de caméra pour permettre aux véhicules de détecter les obstacles, piétons ou cyclistes plus rapidement. Les véhicules équipés de caméras traditionnelles et qui disposent de systèmes de détection perfectionnés d’aide à la conduite doivent aujourd’hui gérer une dizaine de terabytes par heure, et ces systèmes peuvent encore gagner en fiabilité et rapidité.

L’enjeu de l’équipe de recherche est de coupler une caméra neuromorphique à un algorithme de prise de décision sans perdre en efficacité. « Or les algorithmes habituels analysent les images dans leur globalité. On a donc développé un algorithme en phase avec le fonctionnement de la caméra neuromorphique, 5000 fois plus efficace en termes de temps nécessaire à traiter les données pour obtenir un résultat. » Mais pour faire fonctionner l’ensemble du dispositif, les chercheurs doivent également compléter le dispositif d’une caméra qui capture « seulement » vingt images par seconde : « La caméra neuromorphique capture les mouvements, mais pas toute la scène, ajouter une caméra traditionnelle nous permet d’avoir du contexte sur l’environnement d’un véhicule. »

En Chine, une puce qui capte dix mille images par seconde

Pour la suite de ce projet, les chercheurs envisagent d’associer leur système à un LiDAR. « Pour l’heure les caméras permettent de capturer très vite les changements sur une scène, mais ne peuvent pas appréhender la distance entre les objets. Cela aidera le véhicule à disposer de davantage d’informations et donc de savoir combien de temps il a pour prendre une décision. » Dans l’idéal, ils souhaitent également intégrer l’algorithme au sein des capteurs neuromorphiques pour répondre aux attentes de l’industrie automobile. « Pour ce faire, il faudra simplifier l’algorithme », souligne Daniel Gehrig.

L’équipe suisse n’est pas la seule à travailler sur des caméras bio-inspirée pour les véhicules intelligents et les véhicules autonomes. En Chine, le Center for Brain Inspired Computing Research (CBICR) de l’Université de Tsinghua (Pékin) a développé une puce dédiée à la vision baptisée Tianmouc, capable d’acquérir jusqu’à 10.000 images par seconde tout en réduisant la bande passante de 90%. L’objectif est de permettre aux systèmes autonomes de gérer des scénarios extrêmes en évitant les goulets d’étranglement de données. Une technologie hardware en phase avec les progrès rapides de l’intelligence artificielle dans les systèmes autonomes.

Sources :

Gehrig, D., Scaramuzza, D. Low-latency automotive vision with event cameras. Nature 629, 1034–1040 (2024). https://doi.org/10.1038/s41586-024-07409-w

Yang, Z., Wang, T., Lin, Y. et al. A vision chip with complementary pathways for open-world sensing. Nature 629, 1027–1033 (2024). https://doi.org/10.1038/s41586-024-07358-4

Daniel Gehrig

Daniel Gehrig